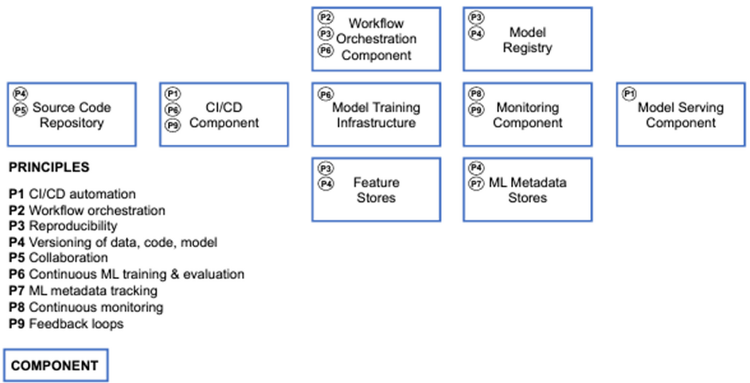

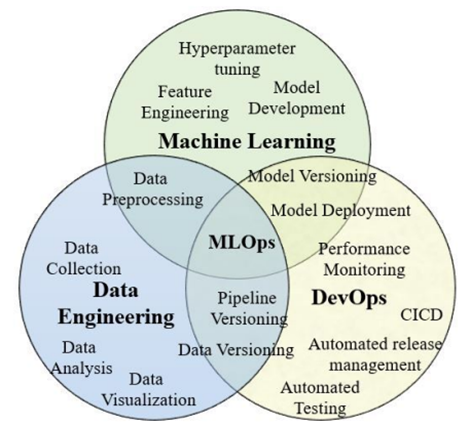

안녕하세요. 마인즈앤컴퍼니입니다. 오늘은 MLOps에 대한 핵심 요소와 구성 컴포넌트, 아키텍처에 대해 잘 정리된 논문이 있어서 소개해 드리려고 합니다. “Machine Learning Operations (MLOps): Overview, Definition, and Architecture” 라는 제목의 논문이며 2022년도에 arXiv에서 퍼블리싱 했습니다. https://arxiv.org/ftp/arxiv/papers/2205/2205.02302.pdf 본 글을 통해 머릿속에 추상적으로 머물러 있던 MLOps의 개념이 어느정도 실체화 될 수 있을거라고 생각합니다. MLOps의 핵심 요소와 컴포넌트 그리고 end-to-end 아키텍처 작성: 마인즈앤컴퍼니 함명호 상무 ML은 데이터의 기반하여 비즈니스를..